Microsoft เปิดตัว UserLM โมเดล AI กลับด้านใหม่ ที่ถูกออกแบบมา เพื่อออกคำสั่งแทนการรับคำสั่ง

ข่าวสาร Ai | .., 11 ตุลาคม 2568 | มาใหม่

Microsoft เปิดตัว UserLM: โมเดล AI ที่ “ออกคำสั่ง” แทนที่จะ “ตอบคำสั่ง”

ในยุคที่โมเดล AI ส่วนใหญ่ถูกออกแบบมาเพื่อตอบสนองต่อคำสั่งของมนุษย์ Microsoft กลับเลือกแนวทางใหม่ด้วยการเปิดตัว UserLM (User Language Model) ซึ่งเป็นโมเดล AI ที่สามารถ “สั่งงานระบบอื่น” ได้ด้วยตัวเอง

แนวคิดและการพัฒนา

UserLM พัฒนาโดยทีมวิจัย Microsoft Research และมีเวอร์ชันเปิดเผยสู่สาธารณะชื่อ UserLM-8B ที่เปิดให้ทดลองบนแพลตฟอร์ม Hugging Face โดยใช้ชุดข้อมูลฝึกจากพฤติกรรมผู้ใช้งานจริงกว่า 3 ล้านตัวอย่าง เพื่อจำลองการตัดสินใจและการออกคำสั่งของมนุษย์

หลักการทำงานของโมเดล

เป้าหมายของ UserLM คือการฝึกให้ AI ทำหน้าที่เหมือน “ผู้ใช้” โดยสังเกตการออกคำสั่งของมนุษย์ เช่น การเลือกใช้เครื่องมือ หรือการโต้ตอบกับระบบ AI อื่น เพื่อสร้างโมเดลที่สามารถเป็น “ตัวกลางอัตโนมัติ” ระหว่างผู้ใช้กับระบบต่างๆ

การประยุกต์ใช้งาน

ตัวอย่างเช่น หากได้รับคำสั่งว่า “จัดประชุมทีมพรุ่งนี้” AI จะดำเนินการต่อโดยอัตโนมัติ เช่น สั่งงาน API ปฏิทิน, ระบบแชท และอีเมล เพื่อจัดการทุกขั้นตอนเองเหมือนผู้ช่วยส่วนตัว

เทคนิคการฝึกสอนขั้นสูง

UserLM ใช้เทคนิค Instruction-Backed Reinforcement Learning (IBRL) ทำให้เข้าใจบริบทและลำดับความสำคัญของคำสั่ง สามารถตัดสินใจและสั่งการอย่างมีเหตุผลในแต่ละสถานการณ์

ก้าวสู่ยุค Multi-Agent AI

Microsoft มองว่า UserLM จะเป็นรากฐานของระบบ Multi-Agent AI ที่โมเดลหลายตัวสามารถสื่อสารและสั่งงานกันเอง เพื่อสร้างกระบวนการอัตโนมัติในระดับองค์กร เช่น ระบบ DevOps หรือการจัดการข้อมูลขนาดใหญ่

กระแสตอบรับจากวงการ

แม้ยังอยู่ในขั้นทดลอง แต่ UserLM ได้รับความสนใจจากชุมชนนักพัฒนา AI อย่างมาก เพราะเป็นแนวคิดที่ “พลิกด้านของ LLM” จาก AI ที่รอรับคำสั่ง มาเป็น AI ที่ออกคำสั่งเองได้ — ก้าวสำคัญที่อาจเปลี่ยนโฉมวงการ AI ทั้งระบบในอนาคต

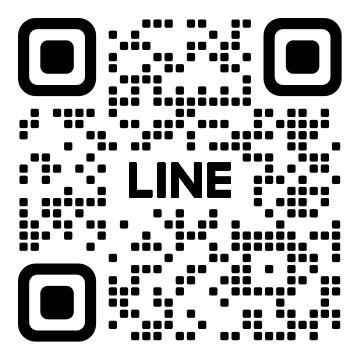

สอบถามได้ที่ Line, Topvery Cloud IDC

เมื่อคุณเจอบัญชีนั้น, คลิก "เพิ่มเพื่อน" หรือ "ติดตาม" เปิดแอป LINE บนอุปกรณ์ของคุณ ไปที่แท็บ เพื่อน ที่มุมล่างขวา กดที่ไอคอน เพิ่มเพื่อน ที่อยู่บนขวามือ ในหน้าต่างที่ปรากฏขึ้น, คุณสามารถค้นหาบัญชี LINE Official ที่ต้องการด้วยชื่อ เมื่อคุณเจอบัญชีนั้น, คลิก เพิ่มเพื่อน หรือ ติดตาม

แอดไลน์ ID @topvery

แอดไลน์ ID @topvery คลิก..?